Военные начинают использовать модели искусственного интеллекта при обслуживании сложных систем вооружения, и это «только начало того, на что способен прогнозирующий ИИ», говорится в докладе председателя совета директоров Центра новой американской безопасности (CNAS) Мишель Флурнуа. «Актуальные комментарии» подготовили обзор документа.

Прогнозирующий ИИ позволит лучше понять намерения потенциальных противников. «В отличие от периода холодной войны, когда в США работали эксперты по СССР, сейчас Соединенные Штаты все еще выясняют, как руководство Китая преобразует политику в конкретные действия. Разведывательное сообщество могло бы, например, разработать большую языковую модель, которая бы включала все доступные сочинения и выступления китайских лидеров, а также отчеты разведки США об этих цифрах, а затем имитировала бы то, как председатель Китая Си Цзиньпин может принять решение о проведении заявленной политики. Аналитики могли бы задать модели конкретные вопросы: „При каких обстоятельствах президент Си будет готов применить силу против Тайваня?“ — и предвидеть потенциальные ответы, основанные на огромном количестве данных из большего количества источников, чем любой человек может когда-либо быстро синтезировать. Они могли бы даже попросить модель показать, как может развернуться кризис и как различные решения повлияют на его результат. Полученные в результате выводы могут быть полезны для информирования аналитиков и политиков при условии, что обучающие наборы будут прозрачными (то есть в них ссылаются источники данных, лежащих в основе ключевых суждений) и заслуживающими доверия», — отмечает автор доклада.

Сотрудники разведки ежедневно используют ИИ для анализа тысяч фотографий и видео. «В прошлом аналитикам приходилось смотреть тысячи часов полноценных видеороликов, чтобы найти и пометить интересующие объекты, будь то скопление танков или рассредоточенные мобильные ракеты. Но с помощью ИИ разработчики могут научить модель изучать весь этот материал и идентифицировать только те объекты, которые ищет аналитик — обычно в течение нескольких секунд или минут. Аналитик также может настроить модель искусственного интеллекта на отправку оповещения всякий раз, когда в определенной географической области обнаруживается новый интересующий объект. Эти инструменты „компьютерного зрения“ позволяют аналитикам тратить больше времени на то, что могут делать только люди: применять свой опыт и суждения для оценки значения и последствий того, что обнаруживает ИИ. По мере того, как эти модели становятся более точными и заслуживающими доверия, они могут помочь командирам на местах принимать важные оперативные решения гораздо быстрее, чем противник может отреагировать», — утверждается в докладе.

ИИ может синтезировать химическое оружие, также его можно использовать для разработки новых патогенов или биологического оружия. «Риски настолько серьезны, что даже лидеры отрасли искусственного интеллекта выразили тревогу. В мае 2023 года руководители почти всех крупных лабораторий искусственного интеллекта в США подписали письмо, предупреждающее, что их изобретения могут представлять реальную угрозу человечеству. Модели ИИ могут, например, ошибочно идентифицировать людей или объекты как цели, что приведет к непреднамеренной гибели и разрушениям во время конфликта. Модели ИИ „черный ящик“, чьи рассуждения невозможно адекватно понять или объяснить, могут привести к тому, что военные планировщики будут принимать опасные решения. Этот риск был бы наиболее острым, если бы ИИ, разработанный для одной ситуации, применялся в другой без достаточного тестирования и надзора. То, что может быть совершенно разумным и ответственным в одной ситуации, может быть иррациональным и опасным в другой», — предупреждает эксперт.

Риски возникают не только из-за плохо спроектированных или небрежно используемых систем. «Например, если противнику удастся подделать инструмент компьютерного зрения с поддержкой искусственного интеллекта и нацелить его на гражданский автомобиль, а не на военный, это может привести к тому, что другая сторона непреднамеренно нанесет удар по гражданскому населению в зоне конфликта. Противник также может повредить данные таким образом, что это ухудшит производительность системы вооружения с поддержкой ИИ или приведет к ее отключению», — говорится в докладе.

Разведывательное сообщество США использует ИИ для просеивания массивов секретных и несекретных данных для прогнозирования международных событий. «В Стратегическом командовании США искусственный интеллект используется для предупреждения чиновников о движении ракет с ядерными боеголовками, которые в прошлом часто ускользали от обнаружения», — говорится в докладе.

Как ИИ изменит вооружённые силы

Источник: actualcomment.ru

17.04.2019 | 6330

07.06.2025 | 1090

16.01.2017 | 15761

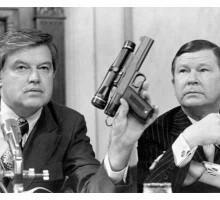

Игольчатая пуля Javette (США): часовые, собаки и «Инфарктный пистолет»