Может ли новейшее вооружение убивать без команды человека?

Организация Future of Life Institute опубликовала открытое письмо, в котором назвала автономные системы вооружения опасными для человечества и потребовала запретить их разработку. Письмо уже подписали больше 16 тысяч человек, в том числе основатель частной космической компании SpaceX Илон Маск, астрофизик Стивен Хокинг, основатель Apple Стив Возняк и философ Ноам Хомский. Военный эксперт Василий Сычев специально объясняет, до какой степени автономности дошло новейшее вооружение и как сейчас регулируется эта сфера.

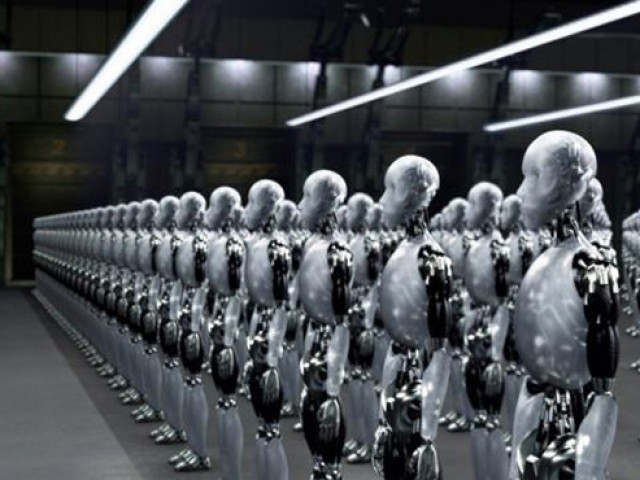

В открытом письме Future of Life Institute говорится, что развитие искусственного интеллекта, которому можно поручить управление вооружением, неизбежно приведет к гонке вооружений — страны станут соревноваться друг с другом в создании все более и более совершенного автономного оружия. При этом сами технологии станут дешевле, доступнее и, в конечном итоге, попадут в руки преступников, террористов, диктаторов и наемников, которые будут использовать их для геноцида, этнических чисток, расширения своих зон влияния.

При этом, по мнению авторов письма, преимущества автономного оружия с искусственным интеллектом весьма сомнительны (правда, серьезных аргументов они не приводят). Более того, не ясно даже, что именно в использовании роботов так пугает подписантов. Восстание машин? Моральный выбор: что считать более правильным и законным — убийство человека человеком или человека машиной? Потенциальная возможность создания оружия, которое будет полностью управляться искусственным интеллектом, и его мотивы и функционирование не будут понимать даже сами создатели? Пока не понятно. Зато в открытом письме утверждается, что полноценные автономные системы вооружения будут созданы в ближайшие несколько лет, не десятилетий.

Автономное оружие

Сейчас многие разработчики автономной боевой техники и систем вооружения условно делят их на три основные категории: «человек-в-системе-управления» (human-in-the-loop), «человек-над-системой-управления» (human-on-the-loop) и «человек-вне-системы-управления» (human-out-of-the-loop).

Подводный аппарат «Концепт-М»

К первой категории относится большинство существующих сегодня автономных подводных необитаемых аппаратов, беспилотных летательных аппаратов и часть наземных роботов. Управление ими практически на всех этапах функционирования осуществляется человеком-оператором — от взлета или погружения до посадки и возвращения на борт корабля. Подводные аппараты типа американского Remus или российского «Концепт-М», беспилотники MQ-9 Reaper или Harpy на каждом этапе управляются человеком, но они же могут выполнять некоторые задания полностью самостоятельно.

К категории «человек-над-системой-управления» относятся системы вооружения, которые функционируют полностью самостоятельно, но человек контролирует их работу постоянно. И в случае любой нестандартной ситуации оператор может переключить управление на себя. В эту категорию, например, попадают все те же беспилотники Reaper, способные самостоятельно взлетать, пролетать по нужному маршруту, обнаруживать цели и возвращаться на базу. Правда, решение о применении оружия по-прежнему остается за человеком. В эту же категорию входят и перспективные транспортные роботы SMSS, которые могут либо самостоятельно перемещаться с грузом патронов и провизии по заданному маршруту или следовать за человеком.

Squad Mission Support System (SMSS)

Наконец, к категории «человек-вне-системы-управления» относятся полностью автономные системы вооружения, которые на каждом из этапов выполнения задания действуют самостоятельно без вмешательства или контроля со стороны человека. Такие системы тоже уже существуют. Например, российские зенитные ракетные комплексы С-400 могут работать полностью самостоятельно, обнаруживая, классифицируя, приоритизируя и поражая воздушные цели. По тому же принципу может функционировать американская корабельная боевая информационно-управляющая система Aegis. Однако, несмотря на возможность переведения этих систем в автономный режим, военные ею не пользуются.

Дело здесь даже не в том, что военные не уверены в надежности уже существующих автономных систем или в опасениях относительно восстания машин, которые вдруг решат, что люди им больше не нужны даже в качестве обслуги. Нет. Просто никакое международное законодательство, никакие Обычаи ведения войны и Женевские конвенции не оговаривают и не регулируют использование полностью автономных оружейных систем в военных конфликтах. Кроме того, не определен и юридический статус таких систем. Если, скажем, солдат вдруг перестрелял целый поселок мирных жителей, понятно, что виноват солдат. А если из-за сбоя робот сделал то же самое? Кого отправлять под трибунал?

Зенитная ракетная система С-400 «Триумф»

Кроме того, сложные системы фактически подразумевают существование в них сложных программных ошибок. Любое автономное оружие с искусственным интеллектом содержит сотни тысяч и миллионы строк программного кода, написанного людьми. И ошибки в программах неизбежны, хотя они и проходят тщательные испытания перед принятием оружейных систем на вооружение, а впоследствии получают программные исправления.

Так, из-за сбоя или ошибки в программном обеспечении системы управления огнем зенитная установка Oerlikon GDF 007 в 2007 году в ЮАР сама открыла огонь, убив девять человек и ранив 14. Из-за ошибки в программном обеспечении в октябре 2014 года Морская пехота США чуть не потеряла конвертоплан MV-22 Osprey. Техник забыл переключить бортовые системы конвертоплана из режима технического обслуживания в нормальный режим, но из-за программной ошибки на приборную панель в кабине пилотов никаких уведомлений не выводилось. В итоге при взлете двигатели машины работали только на половине мощности и конвертоплан, поднявшись над палубой начал плавно опускаться в воду. Во время борьбы за спасение MV-22 аппарат пять раз частично погружался в воду, однако в конечном итоге летчикам все же удалось взлететь достаточно высоко, чтобы посадить конвертоплан обратно на палубу. В результате инцидента один пехотинец утонул.

Человек на вторых ролях

Сегодня многие страны мира занимаются разработкой систем вооружения разной степени автономности. В США ведутся работы по созданию палубных беспилотников, которые смогут работать практически полностью самостоятельно, в том числе наводить на цель и открывать по ней огонь. В России уже созданы охранные роботы для баз Ракетных войск стратегического назначения, которые смогут сами находить и уничтожать предполагаемых преступников. Системы вооружения перспективного танка Т-14 на базе платформы «Армата» смогут сами вести огонь по цели вплоть до ее полного уничтожения.

Военные полагают, что войны будущего будут вестись в бешеном темпе, в котором человек просто не сможет быстро принимать адекватные решения. А значит часть функций, если не все, необходимо будет переложить на роботов. Например, США сегодня формируют список требований к истребителю шестого поколения, который сможет выполнять полеты на гиперзвуковой скорости и будет вооружен лазерами. Так вот этот самолет планируется сделать уже опционально пилотируемым по очень простой причине — скорости, превышающие пять чисел Маха (около шести тысяч километров в час), практически не оставляют летчику времени на принятие решения об ударе по цели или отмене атаки. На таких скоростях необходимы компьютерные системы с большим быстродействием.

Война = игра

Создание любых передовых систем вооружения (необязательно автономных) неминуемо ведет к гонке вооружений. В той или иной форме она продолжается и сейчас. В Пентагоне лелеют концепцию быстрого глобального удара, в рамках которой США смогут атаковать ракетами, бомбами или беспилотниками любую точку планеты в течение не более чем двух часов. В России, в свою очередь, создаются новые системы поражения, включая баллистические ракеты «Сармат», которые смогут «достать» противника даже через Южный полюс.

В области разработки новых вооружений и военной техники всегда происходит цепная реакция. Каждая из сторон старается разработать более мощное, более смертоносное оружие, чтобы защитить и расширить зоны своего политического и экономического влияния. И, чтобы этот процесс прекратился, правительства чуть ли не всех стран должны сесть за стол переговоров и, наконец, определить тот рубеж, за который переходить нельзя.

США, Россия, Германия и еще несколько стран несколько лет назад открыто объявили, что не стремятся заполучить системы вооружения типа «человек-вне-системы-управления», но скорее всего такое оружие все же будет рано или поздно создано. Представлять угрозу для человечества оно будет вовсе не из-за вероятности восстания машин (в которое верится с трудом), а из-за чувства безнаказанности у их владельцев. Именно с повсеместным внедрением роботов война превратится в компьютерную игру, в которой человеческие жизни скроются за безликими значками на экране.